ओपन एआई

OpenAI एक अमेरिकी आर्टिफिशियल इंटेलिजेंस (AI) अनुसंधान प्रयोगशाला है जिसमें गैर-लाभकारी OpenAI निगमित और इसके लाभकारी सहायक निगम OpenAI Limited Partnership शामिल हैं। OpenAI मित्रवत AI को बढ़ावा देने और विकसित करने के घोषित इरादे से AI अनुसंधान करता है। OpenAI सिस्टम Microsoft के एज़्योर -आधारित सुपरकंप्यूटिंग प्लेटफ़ॉर्म पर चलता है।

इसका हम उपयोग हम किसी कथन को ज्ञात करने के लिए करते हैं जैसे की आर्टिकल राइटिंग ., प्रश्नों को हल करना , कई कंपनियां भी करती है OpenAI की स्थापना 2015 में Ilya Sutskever, Greg Brockman, Trevor Blackwell, Vicki Cheung, Andrej Karpathy, Durk Kingma, John Schulman, Pamela Vagata, और Wojciech Zaremba द्वारा की गई थी, जिसमें सैम ऑल्टमैन और एलोन मस्क प्रारंभिक बोर्ड के सदस्य थे। Microsoft ने OpenAI LP को $1 प्रदान किया 2019 में अरब डॉलर का निवेश और 2023 में 10 अरब डॉलर का निवेश

इतिहास

2015–2018: गैर-लाभकारी शुरुआत

दिसंबर 2015 में, सैम ऑल्टमैन, ग्रेग ब्रॉकमैन, रीड हॉफमैन, जेसिका लिविंगस्टन, पीटर थिएल, एलोन मस्क, अमेज़ॅन वेब सर्विसेज (एडब्ल्यूएस), इंफोसिस और वाईसी रिसर्च ने ओपनएआई के गठन की घोषणा की और $1 से अधिक का वादा किया। उद्यम के लिए अरब। संगठन ने कहा कि वह अपने पेटेंट और शोध को जनता के लिए खोलकर अन्य संस्थानों और शोधकर्ताओं के साथ "स्वतंत्र रूप से सहयोग" करेगा। OpenAI का मुख्यालय सैन फ्रांसिस्को के मिशन डिस्ट्रिक्ट में पायनियर बिल्डिंग में है।

वायर्ड के अनुसार, ब्रॉकमैन ने डीप लर्निंग मूवमेंट के "संस्थापक पिता" में से एक, योशुआ बेंगियो से मुलाकात की, और "क्षेत्र में सर्वश्रेष्ठ शोधकर्ताओं" की एक सूची तैयार की। ब्रॉकमैन उनमें से नौ को दिसंबर 2015 में पहले कर्मचारी के रूप में नियुक्त करने में सक्षम था 2016 में OpenAI ने कॉर्पोरेट-स्तर (गैर-लाभकारी-स्तर के बजाय) वेतन का भुगतान किया, लेकिन AI शोधकर्ताओं के वेतन का भुगतान फेसबुक या Google के बराबर नहीं किया।

माइक्रोसॉफ्ट के पीटर ली ने कहा कि शीर्ष एआई शोधकर्ता की लागत शीर्ष एनएफएल क्वार्टरबैक संभावना की लागत से अधिक है। OpenAI की क्षमता और मिशन ने इन शोधकर्ताओं को फर्म की ओर आकर्षित किया; एक Google कर्मचारी ने कहा कि वह OpenAI के लिए Google को छोड़ने को तैयार था "आंशिक रूप से लोगों के बहुत मजबूत समूह के कारण और बहुत हद तक, इसके मिशन के कारण।" ब्रॉकमैन ने कहा कि "सबसे अच्छी चीज जिसकी मैं कल्पना कर सकता था वह थी मानवता को एक सुरक्षित तरीके से वास्तविक एआई के निर्माण के करीब ले जाना।" OpenAI के सह-संस्थापक वोज्शिएक ज़रेम्बा ने कहा कि उन्होंने OpenAI में शामिल होने के लिए अपने बाजार मूल्य के दो से तीन गुना के "बॉर्डरलाइन क्रेजी" प्रस्तावों को ठुकरा दिया।

अप्रैल 2016 में, OpenAI ने "OpenAI जिम" का एक सार्वजनिक बीटा जारी किया, जो सुदृढीकरण सीखने के अनुसंधान के लिए इसका मंच है। दिसंबर 2016 में, OpenAI ने "यूनिवर्स" जारी किया, जो गेम, वेबसाइटों और अन्य अनुप्रयोगों की दुनिया भर में AI की सामान्य बुद्धिमत्ता को मापने और प्रशिक्षित करने के लिए एक सॉफ्टवेयर प्लेटफॉर्म है।

2017 में OpenAI ने $7.9 खर्च किए अकेले क्लाउड कंप्यूटिंग पर मिलियन, या इसके कार्यात्मक व्यय का एक चौथाई। इसकी तुलना में, 2017 में डीपमाइंड का कुल खर्च $442 था दस लाख। 2018 की गर्मियों में, OpenAI के Dota 2 बॉट्स को प्रशिक्षित करने के लिए Google से कई हफ्तों के लिए 128,000 CPU और 256 GPU किराए पर लेने की आवश्यकता होती है।

2018 में, मस्क ने सेल्फ-ड्राइविंग कारों के लिए टेस्ला के एआई विकास के कारण टेस्ला के सीईओ के रूप में अपनी भूमिका के साथ "संभावित भविष्य के संघर्ष " का हवाला देते हुए अपनी बोर्ड सीट से इस्तीफा दे दिया। सैम ऑल्टमैन का दावा है कि मस्क का मानना था कि OpenAI Google जैसे अन्य खिलाड़ियों के पीछे पड़ गया था और मस्क ने इसके बजाय OpenAI को खुद लेने का प्रस्ताव दिया, जिसे बोर्ड ने अस्वीकार कर दिया। कस्तूरी ने बाद में OpenAI को छोड़ दिया लेकिन एक दाता बने रहने का दावा किया, फिर भी उनके जाने के बाद कोई दान नहीं किया।

2019: फ़ायदे के लिए संक्रमण

2019 में, OpenAI ने गैर-लाभकारी से लाभ के लिए "कैप्ड" में परिवर्तन किया, जिसमें लाभ किसी भी निवेश के 100 गुना पर छाया हुआ था। OpenAI के अनुसार, कैप्ड-प्रॉफिट मॉडल OpenAI LP को कानूनी तौर पर वेंचर फंड से निवेश आकर्षित करने की अनुमति देता है, और इसके अलावा, कर्मचारियों को कंपनी में हिस्सेदारी देने के लिए, लक्ष्य यह है कि वे कह सकते हैं कि "मैं OpenAI में जा रहा हूं, लेकिन इसमें लंबे समय तक यह एक परिवार के रूप में हमारे लिए नुकसानदेह नहीं होगा।" कई शीर्ष शोधकर्ता Google ब्रेन, डीपमाइंड, या फेसबुक के लिए काम करते हैं, जो स्टॉक विकल्प प्रदान करते हैं जो एक गैर-लाभकारी संस्था करने में असमर्थ होगी। परिवर्तन से पहले, OpenAI में शीर्ष कर्मचारियों के मुआवजे का सार्वजनिक खुलासा कानूनी रूप से आवश्यक था।

कंपनी ने तब अपने कर्मचारियों को इक्विटी वितरित की और Microsoft के साथ भागीदारी की, $1 के निवेश पैकेज की घोषणा की कंपनी में अरब। OpenAI ने अपनी प्रौद्योगिकियों को व्यावसायिक रूप से लाइसेंस देने के अपने इरादे की भी घोषणा की। OpenAI ने $1 खर्च करने की योजना बनाई है बिलियन "पांच साल के भीतर, और संभवतः बहुत तेज।" ऑल्टमैन ने कहा है कि एक अरब डॉलर भी अपर्याप्त हो सकता है, और कृत्रिम सामान्य बुद्धि प्राप्त करने के लिए प्रयोगशाला को अंततः "किसी भी गैर-लाभकारी से अधिक पूंजी की आवश्यकता हो सकती है"।

एआई के लिए गैर-लाभकारी एलन इंस्टीट्यूट के ओरेन एट्ज़ियोनी द्वारा एक गैर-लाभकारी कंपनी से कैप्ड-प्रॉफिट कंपनी में परिवर्तन को संदेह के साथ देखा गया था, जो इस बात से सहमत थे कि एक गैर-लाभकारी संस्था के लिए शीर्ष शोधकर्ताओं को लुभाना मुश्किल है, लेकिन कहा "मैं इस धारणा से असहमत हूं कि एक गैर-लाभकारी संस्था 'प्रतिस्पर्धा नहीं' और OpenAI और अन्य द्वारा सफल कम बजट वाली परियोजनाओं की ओर इशारा किया। "यदि बड़ा और बेहतर वित्त पोषित हमेशा बेहतर होता, तो आईबीएम अभी भी नंबर एक होता।"

गैर-लाभकारी, OpenAI Inc., OpenAI LP का एकमात्र नियंत्रक शेयरधारक है। OpenAI LP, एक फ़ायदेमंद कंपनी होने के बावजूद, OpenAI Inc. के गैर-लाभकारी चार्टर के लिए एक औपचारिक प्रत्ययी ज़िम्मेदारी बरकरार रखती है। OpenAI Inc. के अधिकांश बोर्ड को OpenAI LP में वित्तीय हिस्सेदारी रखने से रोक दिया गया है। इसके अलावा, ओपनएआई एलपी में हिस्सेदारी वाले अल्पसंख्यक सदस्यों को हितों के टकराव के कारण कुछ मतों से रोक दिया गया है। कुछ शोधकर्ताओं ने तर्क दिया है कि OpenAI LP का लाभकारी स्थिति में स्विच करना OpenAI के एआई के "लोकतांत्रिककरण" के दावों के साथ असंगत है।

2020-वर्तमान: चैटजीपीटी, डीएएल-ई और माइक्रोसॉफ्ट के साथ साझेदारी

2020 में, OpenAI ने GPT-3 की घोषणा की, जो बड़े इंटरनेट डेटासेट पर प्रशिक्षित एक भाषा मॉडल है। GPT-3 का उद्देश्य प्राकृतिक भाषा में प्रश्नों के उत्तर देना है, लेकिन यह भाषाओं के बीच अनुवाद भी कर सकता है और सुसंगत रूप से सुधारित पाठ उत्पन्न कर सकता है। इसने यह भी घोषणा की कि एक संबद्ध एपीआई, जिसे केवल "एपीआई" नाम दिया गया है, इसके पहले वाणिज्यिक उत्पाद का केंद्र होगा।

2021 में, OpenAI ने DALL-E पेश किया, एक गहन शिक्षण मॉडल जो प्राकृतिक भाषा विवरणों से डिजिटल चित्र उत्पन्न कर सकता है।

दिसंबर 2022 में, OpenAI ने GPT-3.5 पर आधारित अपने नए AI चैटबॉट, ChatGPT का मुफ्त पूर्वावलोकन लॉन्च करने के बाद व्यापक मीडिया कवरेज प्राप्त किया। OpenAI के अनुसार, पूर्वावलोकन को पहले पांच दिनों के भीतर एक मिलियन से अधिक साइनअप प्राप्त हुए। दिसंबर 2022 में रॉयटर्स द्वारा उद्धृत अनाम स्रोतों के अनुसार, OpenAI ने 2023 में $200 मिलियन राजस्व और 2024 में $1 बिलियन राजस्व का अनुमान लगाया था

जनवरी 2023 तक, OpenAI फंडिंग के लिए बातचीत कर रहा था जो कंपनी को $29 बिलियन का मूल्य देगा, 2021 में कंपनी के मूल्य को दोगुना कर देगा 23 जनवरी, 2023 को, Microsoft ने OpenAI में एक नए बहु-वर्षीय 10 बिलियन अमरीकी डालर के निवेश की घोषणा की।

माना जाता है कि यह निवेश ओपनएआई के चैटजीपीटी को बिंग सर्च इंजन में एकीकृत करने के माइक्रोसॉफ्ट के प्रयासों का एक हिस्सा है। ChatGPT के लॉन्च होने के बाद, Google ने एक समान AI एप्लिकेशन ( बार्ड ) की घोषणा की, इस डर से कि ChatGPT जानकारी के स्रोत के रूप में Google की जगह को खतरे में डाल सकता है।

7 फरवरी, 2023 को, माइक्रोसॉफ्ट ने घोषणा की कि वह माइक्रोसॉफ्ट बिंग, एज, माइक्रोसॉफ्ट 365 और अन्य उत्पादों में चैटजीपीटी के समान आधार पर एआई तकनीक का निर्माण कर रहा है।

3 मार्च, 2023 को, रीड हॉफमैन ने OpenAI में अपनी बोर्ड सीट और ग्रेलॉक पार्टनर्स के माध्यम से AI प्रौद्योगिकी कंपनियों में अपने निवेश के साथ-साथ सह-संस्थापक के रूप में अपनी भूमिका के बीच हितों के टकराव से बचने की इच्छा का हवाला देते हुए अपनी बोर्ड सीट से इस्तीफा दे दिया। एआई प्रौद्योगिकी स्टार्टअप इन्फ्लेक्शन एआई। हॉफमैन ओपनएआई में एक प्रमुख निवेशक माइक्रोसॉफ्ट के बोर्ड में बने रहे।

14 मार्च, 2023 को, OpenAI ने GPT-4 जारी किया, दोनों एक एपीआई (प्रतीक्षा सूची के साथ) और चैटजीपीटी प्लस की एक विशेषता के रूप में।

26 अप्रैल, 2023 को, OpenAI ने घोषणा की कि PwC OpenAI में $1 बिलियन का निवेश करेगा और GPT-4 और Microsoft Azure OpenAI सेवा का उपयोग करेगा।

प्रतिभागियों

प्रमुख कर्मचारी:

- सीईओ और सह-संस्थापक: सैम ऑल्टमैन, स्टार्टअप एक्सेलरेटर वाई कॉम्बिनेटर के पूर्व अध्यक्ष

- अध्यक्ष और सह-संस्थापक: ग्रेग ब्रॉकमैन, पूर्व सीटीओ, स्ट्राइप के तीसरे कर्मचारी

- मुख्य वैज्ञानिक और सह-संस्थापक: इल्या सुतस्केवर, मशीन लर्निंग पर Google के पूर्व विशेषज्ञ

- मुख्य प्रौद्योगिकी अधिकारी: मीरा मुराती, पहले लीप मोशन और टेस्ला, इंक।

- चीफ ऑपरेटिंग ऑफिसर: ब्रैड लाइटकैप, पहले वाई कॉम्बिनेटर और जेपी मॉर्गन चेस में

OpenAI गैर-लाभकारी बोर्ड:

- ग्रेग ब्रॉकमैन

- इल्या सुतस्केवर

- सैम ऑल्टमैन

- एडम डी एंजेलो

- विल हर्ड

- ताशा मैककौली

- हेलेन टोनर

- शिवोन ज़िलिस

- लिंक्डइन के सह-संस्थापक रीड हॉफमैन

- पीटर थिएल, पेपाल के सह-संस्थापक

- जेसिका लिविंगस्टन, वाई कॉम्बिनेटर की संस्थापक भागीदार हैं

कॉर्पोरेट निवेशक:

- माइक्रोसॉफ्ट

- खोसला वेंचर्स

- इन्फोसिस

रणनीति

मस्क ने सवाल उठाया: "भविष्य अच्छा है यह सुनिश्चित करने के लिए हम सबसे अच्छी चीज क्या कर सकते हैं? हम किनारे पर बैठ सकते हैं या हम विनियामक निरीक्षण को प्रोत्साहित कर सकते हैं, या हम ऐसे लोगों के साथ सही संरचना में भाग ले सकते हैं जो एआई को सुरक्षित और मानवता के लिए फायदेमंद तरीके से विकसित करने के बारे में गहराई से परवाह करते हैं।" मस्क ने स्वीकार किया कि "हमेशा कुछ जोखिम होता है कि वास्तव में (दोस्ताना) एआई को आगे बढ़ाने की कोशिश में हम वह चीज बना सकते हैं जिसके बारे में हम चिंतित हैं"; फिर भी, सबसे अच्छा बचाव है "अधिक से अधिक लोगों को एआई प्राप्त करने के लिए सशक्त बनाना। यदि सभी के पास एआई शक्तियाँ हैं, तो कोई एक व्यक्ति या व्यक्तियों का एक छोटा समूह नहीं है जिसके पास एआई महाशक्ति हो।"

कस्तूरी और ऑल्टमैन की काउंटर-सहज ज्ञान युक्त रणनीति जोखिम को कम करने की कोशिश कर रही है कि एआई सभी को एआई देकर समग्र नुकसान पहुंचाएगा, उन लोगों के बीच विवादास्पद है जो कृत्रिम बुद्धि से अस्तित्वगत जोखिम से संबंधित हैं। दार्शनिक निक बोस्सोम मस्क के दृष्टिकोण पर संदेह करते हैं: "यदि आपके पास एक बटन है जो दुनिया के लिए बुरा काम कर सकता है, तो आप इसे हर किसी को नहीं देना चाहते।" तकनीकी विलक्षणता के बारे में 2016 की एक बातचीत के दौरान, ऑल्टमैन ने कहा कि "हम अपने सभी स्रोत कोड को जारी करने की योजना नहीं बनाते हैं" और "दुनिया के व्यापक स्वाथों को एक नए शासन बोर्ड के प्रतिनिधियों का चुनाव करने की अनुमति देने" की योजना का उल्लेख किया। ग्रेग ब्रॉकमैन ने कहा कि "अभी हमारा लक्ष्य... सबसे अच्छा काम करना है जो करना है। यह थोड़ा अस्पष्ट है।"

इसके विपरीत, संभावित दुरुपयोग की उपस्थिति में "सावधानी की ओर गलती" करने की इच्छा के कारण GPT-2 को रोकने के OpenAI के प्रारंभिक निर्णय की खुलेपन के समर्थकों द्वारा आलोचना की गई है। टेक्स्ट जेनरेशन के विशेषज्ञ दिलीप राव ने कहा, "मुझे नहीं लगता कि ओपनएआई ] यह साबित करने में पर्याप्त समय लगाया कि [GPT-2] जीपीटी-2 ] वास्तव में खतरनाक था।" अन्य आलोचकों ने तर्क दिया कि अनुसंधान को दोहराने और प्रतिउपायों के साथ आने में सक्षम होने के लिए खुला प्रकाशन आवश्यक है।

हाल ही में, 2022 में, OpenAI ने संरेखण समस्या के प्रति अपना दृष्टिकोण प्रकाशित किया। वे उम्मीद करते हैं कि एजीआई को मानवीय मूल्यों के साथ संरेखित करना वर्तमान एआई सिस्टम को संरेखित करने की तुलना में कठिन है : "असंरेखित AGI मानवता के लिए पर्याप्त जोखिम पैदा कर सकता है और AGI संरेखण समस्या को हल करना इतना कठिन हो सकता है कि इसके लिए सभी मानवता को एक साथ काम करने की आवश्यकता होगी"। वे एआई सिस्टम को प्रशिक्षित करने के लिए मानवीय प्रतिक्रिया का बेहतर उपयोग करने का तरीका तलाशते हैं। वे संरेखण अनुसंधान को स्वचालित रूप से स्वचालित करने के लिए एआई का उपयोग करने पर भी विचार करते हैं।

उत्पाद और अनुप्रयोग

जिम

2016 में घोषित, जिम का उद्देश्य विभिन्न प्रकार के वातावरणों पर आसानी से कार्यान्वित सामान्य-इंटेलिजेंस बेंचमार्क प्रदान करना है - पर्यवेक्षित शिक्षण अनुसंधान में उपयोग किए जाने वाले इमेजनेट लार्ज स्केल विज़ुअल रिकॉग्निशन चैलेंज के समान, लेकिन उससे व्यापक। यह एआई अनुसंधान प्रकाशनों में पर्यावरण को परिभाषित करने के तरीके को मानकीकृत करने की उम्मीद करता है, ताकि प्रकाशित शोध अधिक आसानी से पुनरुत्पादित हो सके। परियोजना उपयोगकर्ता को एक सरल इंटरफ़ेस प्रदान करने का दावा करती है। जून तक

2017, जिम का उपयोग केवल पायथन के साथ किया जा सकता है। सितंबर 2017 तक, जिम प्रलेखन साइट का रखरखाव नहीं किया गया था, और सक्रिय कार्य इसके गिटहब पृष्ठ पर केंद्रित था। साँचा:Primary source inline

रोबोसुमो

2017 में रिलीज़ किया गया, रोबोसुमो एक आभासी दुनिया है जहाँ ह्यूमनॉइड मेटललर्निंग रोबोट एजेंटों को शुरू में ज्ञान की कमी होती है कि कैसे चलना है, लेकिन उन्हें विरोधी एजेंट को रिंग से बाहर ले जाने और धकेलने के लिए सीखने का लक्ष्य दिया जाता है। इस प्रतिकूल सीखने की प्रक्रिया के माध्यम से, एजेंट सीखते हैं कि बदलती परिस्थितियों के अनुकूल कैसे बनाया जाए; जब एक एजेंट को इस आभासी वातावरण से हटा दिया जाता है और तेज़ हवाओं के साथ एक नए आभासी वातावरण में रखा जाता है, तो एजेंट सीधा रहने के लिए तैयार हो जाता है, यह सुझाव देता है कि उसने सामान्य तरीके से संतुलन बनाना सीख लिया है। OpenAI के इगोर मोर्डैच का तर्क है कि एजेंटों के बीच प्रतिस्पर्धा एक खुफिया "हथियारों की दौड़" बना सकती है जो प्रतियोगिता के संदर्भ के बाहर भी एक एजेंट की कार्य करने की क्षमता को बढ़ा सकती है।

वीडियो गेम बॉट और बेंचमार्क

ओपनएआई पांच

ओपनएआई फाइव पांच ओपनएआई-क्यूरेटेड बॉट्स की एक टीम का नाम है जो प्रतिस्पर्धी पांच-ऑन-फाइव वीडियो गेम डोटा 2 में उपयोग किया जाता है, जो पूरी तरह से परीक्षण-और-त्रुटि एल्गोरिदम के माध्यम से उच्च कौशल स्तर पर मानव खिलाड़ियों के खिलाफ खेलना सीखते हैं। . पांच की टीम बनने से पहले, द इंटरनेशनल 2017 में पहला सार्वजनिक प्रदर्शन हुआ, खेल के लिए वार्षिक प्रीमियर चैंपियनशिप टूर्नामेंट, जहां एक पेशेवर यूक्रेनी खिलाड़ी डेंडी एक लाइव वन-ऑन-वन मैचअप में एक बॉट के खिलाफ हार गया। मैच के बाद, सीटीओ ग्रेग ब्रॉकमैन ने समझाया कि बॉट ने दो सप्ताह के वास्तविक समय में खुद के खिलाफ खेलकर सीखा था, और सीखने वाला सॉफ्टवेयर सॉफ्टवेयर बनाने की दिशा में एक कदम था जो एक सर्जन जैसे जटिल कार्यों को संभाल सकता है। सिस्टम रीइन्फोर्समेंट लर्निंग के एक रूप का उपयोग करता है, क्योंकि बॉट समय के साथ महीनों तक दिन में सैकड़ों बार खुद के खिलाफ खेलकर सीखते हैं, और उन्हें दुश्मन को मारने और मानचित्र के उद्देश्यों को लेने जैसे कार्यों के लिए पुरस्कृत किया जाता है।

जून 2018 तक, बॉट्स की क्षमता पांच की पूरी टीम के रूप में एक साथ खेलने के लिए विस्तारित हुई, और वे शौकिया और अर्ध-पेशेवर खिलाड़ियों की टीमों को हराने में सक्षम थे। द इंटरनेशनल 2018 में, ओपनएआई फाइव ने पेशेवर खिलाड़ियों के खिलाफ दो प्रदर्शनी मैच खेले, लेकिन दोनों गेम हार गए। अप्रैल 2019 में, ओपनएआई फाइव ने सैन फ्रांसिस्को में एक लाइव प्रदर्शनी मैच में उस समय के विश्व चैंपियन ओजी को 2-0 से हराया। बॉट्स की अंतिम सार्वजनिक उपस्थिति उस महीने बाद में आई, जहां उन्होंने चार दिवसीय खुली ऑनलाइन प्रतियोगिता में कुल 42,729 गेम खेले, जिसमें से 99.4% गेम जीते।

जिम रेट्रो

2018 में जारी, जिम रेट्रो वीडियो गेम पर आरएल अनुसंधान के लिए एक मंच है। जिम रेट्रो का उपयोग आरएल एल्गोरिदम पर शोध करने और सामान्यीकरण का अध्ययन करने के लिए किया जाता है। आरएल में पहले के शोध ने मुख्य रूप से एकल कार्यों को हल करने के लिए एजेंटों को अनुकूलित करने पर ध्यान केंद्रित किया है। जिम रेट्रो समान अवधारणाओं लेकिन अलग-अलग दिखावे वाले खेलों के बीच सामान्यीकरण करने की क्षमता देता है।

बहस का खेल

2018 में, OpenAI ने डिबेट गेम लॉन्च किया, जो मानव न्यायाधीश के सामने खिलौनों की समस्याओं पर बहस करना सिखाता है। इसका उद्देश्य शोध करना है कि क्या ऐसा दृष्टिकोण एआई निर्णयों के ऑडिट में और व्याख्यात्मक एआई विकसित करने में सहायता कर सकता है।

डैक्टाइल

2018 में विकसित, डैक्टाइल भौतिक वस्तुओं में हेरफेर करने के लिए एक शैडो हैंड, एक मानव-जैसे रोबोट हाथ को प्रशिक्षित करने के लिए मशीन लर्निंग का उपयोग करता है। यह OpenAI Five के समान RL एल्गोरिदम और प्रशिक्षण कोड का उपयोग करके पूरी तरह से सिमुलेशन में सीखता है। OpenAI ने डोमेन रेंडमाइजेशन का उपयोग करके ऑब्जेक्ट ओरिएंटेशन समस्या का सामना किया, एक सिमुलेशन दृष्टिकोण जो शिक्षार्थी को वास्तविकता में फिट होने की कोशिश करने के बजाय विभिन्न प्रकार के अनुभवों को उजागर करता है। मोशन ट्रैकिंग कैमरों के अलावा, डैक्टाइल के सेट-अप में आरजीबी कैमरे भी हैं जो रोबोट को किसी मनमानी वस्तु को देखकर हेरफेर करने की अनुमति देते हैं। 2018 में, OpenAI ने दिखाया कि सिस्टम एक घन और एक अष्टकोणीय प्रिज्म में हेरफेर करने में सक्षम था।

2019 में, OpenAI ने प्रदर्शित किया कि Dactyl रूबिक क्यूब को हल कर सकता है। रोबोट 60% समय पहेली को हल करने में सक्षम था। रूबिक क्यूब जैसी वस्तुएं जटिल भौतिकी का परिचय देती हैं जो मॉडल के लिए कठिन है। ओपनएआई ने गड़बड़ी के लिए डैक्टिल की मजबूती में सुधार करके इसे हल किया; उन्होंने स्वचालित डोमेन रेंडमाइजेशन (एडीआर) नामक एक तकनीक का इस्तेमाल किया, एक सिमुलेशन दृष्टिकोण जहां उत्तरोत्तर अधिक कठिन वातावरण अंतहीन रूप से उत्पन्न होते हैं। एडीआर मैनुअल डोमेन रैंडमाइजेशन से अलग है, जिसमें रैंडमाइजेशन रेंज निर्दिष्ट करने के लिए मानव की जरूरत नहीं है।

एपीआई

जून 2020 में, OpenAI ने एक बहुउद्देश्यीय API की घोषणा की, जिसमें कहा गया था कि "OpenAI द्वारा विकसित नए AI मॉडल तक पहुँचने के लिए" डेवलपर्स को "किसी भी अंग्रेजी भाषा AI कार्य" के लिए कॉल करने दें।

जनरेटिव मॉडल

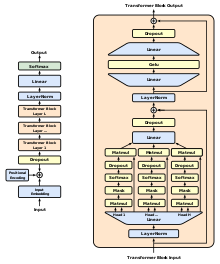

OpenAI का मूल GPT मॉडल ("GPT-1")

ट्रांसफार्मर -आधारित भाषा मॉडल के जनरेटिव प्री-ट्रेनिंग पर मूल पेपर एलेक रेडफोर्ड और उनके सहयोगियों द्वारा लिखा गया था, और 11 जून, 2018 को OpenAI की वेबसाइट पर प्रीप्रिंट में प्रकाशित हुआ था इसने दिखाया कि कैसे भाषा का एक जनरेटिव मॉडल विश्व ज्ञान प्राप्त करने में सक्षम है और सन्निहित पाठ के लंबे खंडों के साथ विविध कॉर्पस पर पूर्व-प्रशिक्षण द्वारा लंबी दूरी की निर्भरता को संसाधित करता है।

जीपीटी-2

जनरेटिव पूर्व-प्रशिक्षित ट्रांसफार्मर 2 ("जीपीटी-2") एक अप्रशिक्षित ट्रांसफार्मर भाषा मॉडल है और ओपनएआई के मूल जीपीटी मॉडल ("जीपीटी-1") का उत्तराधिकारी है। GPT-2 को पहली बार फरवरी 2019 में घोषित किया गया था, शुरुआत में केवल सीमित प्रदर्शनकारी संस्करण जनता के लिए जारी किए गए थे। GPT-2 का पूर्ण संस्करण नकली समाचार लिखने के लिए आवेदनों सहित संभावित दुरूपयोग की चिंता के कारण तुरंत जारी नहीं किया गया था। कुछ विशेषज्ञों ने संदेह व्यक्त किया कि GPT-2 ने एक महत्वपूर्ण खतरा उत्पन्न किया है।

एलन इंस्टीट्यूट फॉर आर्टिफिशियल इंटेलिजेंस ने "न्यूरल फेक न्यूज" का पता लगाने के लिए एक टूल के साथ GPT-2 का जवाब दिया। जेरेमी हॉवर्ड जैसे अन्य शोधकर्ताओं ने "ट्विटर, ईमेल और वेब को पूरी तरह से उचित-ध्वनि, संदर्भ-उपयुक्त गद्य के साथ भरने की तकनीक की चेतावनी दी, जो अन्य सभी भाषणों को डूब जाएगा और फ़िल्टर करना असंभव होगा"। नवंबर 2019 में, OpenAI ने GPT-2 भाषा मॉडल का पूर्ण संस्करण जारी किया। कई वेबसाइटें GPT-2 और अन्य ट्रांसफार्मर मॉडल के विभिन्न उदाहरणों के इंटरैक्टिव प्रदर्शनों की मेजबानी करती हैं।

GPT-2 के लेखक गैर-पर्यवेक्षित भाषा मॉडल को सामान्य-उद्देश्य के शिक्षार्थी होने का तर्क देते हैं, GPT-2 द्वारा सचित्र 8 शून्य-शॉट कार्यों में से 7 पर अत्याधुनिक सटीकता और उलझन प्राप्त करना (यानी मॉडल को किसी भी कार्य पर आगे प्रशिक्षित नहीं किया गया था) विशिष्ट इनपुट-आउटपुट उदाहरण)।

वेबटेक्स्ट कहे जाने वाले कोष पर इसे प्रशिक्षित किया गया था, जिसमें कम से कम 3 अपवोट के साथ Reddit सबमिशन में साझा किए गए URL से कुल 40 गीगाबाइट टेक्स्ट के लिए 8 मिलियन से अधिक दस्तावेज़ शामिल हैं। यह बाइट जोड़ी एन्कोडिंग का उपयोग कर शब्द टोकन के साथ शब्दावली एन्कोडिंग कुछ मुद्दों से बचाता है। यह व्यक्तिगत वर्णों और एकाधिक-वर्ण टोकन दोनों को एन्कोड करके वर्णों की किसी भी स्ट्रिंग का प्रतिनिधित्व करने की अनुमति देता है।

जीपीटी-3

पहली बार मई 2020 में वर्णित, जनरेटिव प्री-ट्रेन्ड ट्रांसफॉर्मर 3 (जीपीटी-3) एक अप्रशिक्षित ट्रांसफॉर्मर लैंग्वेज मॉडल और जीपीटी-2 का उत्तराधिकारी है। OpenAI ने कहा कि GPT-3 के पूर्ण संस्करण में 175 शामिल हैं बिलियन पैरामीटर, परिमाण के दो आदेश 1.5 से बड़े हैं बिलियन पैरामीटर GPT-2 के पूर्ण संस्करण में (हालांकि GPT-3 मॉडल के रूप में कम से कम 125 मिलियन पैरामीटर भी प्रशिक्षित किए गए थे)।

OpenAI ने कहा कि GPT-3 कुछ " मेटा-लर्निंग " कार्यों में सफल होता है। यह एकल इनपुट-आउटपुट जोड़ी के उद्देश्य को सामान्य कर सकता है। पेपर अंग्रेजी और रोमानियाई के बीच और अंग्रेजी और जर्मन के बीच अनुवाद और क्रॉस-भाषाई स्थानांतरण सीखने का एक उदाहरण देता है।

GPT-3 ने GPT-2 की तुलना में बेंचमार्क परिणामों में नाटकीय रूप से सुधार किया। OpenAI ने आगाह किया है कि भाषा मॉडल के इस तरह के स्केलिंग को भविष्यवाणिय भाषा मॉडल की मौलिक क्षमता सीमाओं के निकट या सामना करना पड़ सकता है। पूर्व-प्रशिक्षण GPT-3 को पूर्ण GPT-2 मॉडल के लिए दसियों पेटाफ्लॉप/s-दिनों की तुलना में कई हज़ार पेटाफ़्लॉप/s-दिनों की गणना की आवश्यकता होती है। अपने पूर्ववर्ती की तरह, GPT-3 का पूरी तरह से प्रशिक्षित मॉडल संभावित दुरुपयोग के आधार पर तुरंत जनता के लिए जारी नहीं किया गया था, हालांकि OpenAI ने दो महीने के नि:शुल्क निजी बीटा के शुरू होने के बाद सशुल्क क्लाउड एपीआई के माध्यम से पहुंच की अनुमति देने की योजना बनाई थी। जून 2020 में।

23 सितंबर, 2020 को GPT-3 को विशेष रूप से Microsoft के लिए लाइसेंस दिया गया था।

ज़ाब्ता

2021 के मध्य में घोषित, कोडेक्स GPT-3 का वंशज है जिसे अतिरिक्त रूप से 54 मिलियन GitHub रिपॉजिटरी से कोड पर प्रशिक्षित किया गया है, और AI कोड ऑटोकंप्लीशन टूल GitHub Copilot को शक्ति प्रदान करता है। अगस्त 2021 में, निजी बीटा में एक एपीआई जारी किया गया था। OpenAI के अनुसार, मॉडल एक दर्जन से अधिक प्रोग्रामिंग भाषाओं में कार्य कोड बनाने में सक्षम है, सबसे प्रभावी रूप से Python में।

ग्लिट्स, डिज़ाइन की खामियों और सुरक्षा कमजोरियों के साथ कई मुद्दों को सामने लाया गया है।

गिटहब कॉपिलॉट पर कॉपीराइट कोड का उत्सर्जन करने का आरोप लगाया गया है, जिसमें कोई लेखक विशेषता या लाइसेंस नहीं है।

OpenAI ने घोषणा की कि वे 23 मार्च, 2023 से कोडेक्स एपीआई के लिए समर्थन बंद करने जा रहे हैं

व्हिस्पर

2022 में जारी, व्हिस्पर एक सामान्य-उद्देश्य वाली वाक् पहचान मॉडल है। इसे विविध ऑडियो के एक बड़े डेटासेट पर प्रशिक्षित किया गया है और यह एक बहु-कार्य मॉडल भी है जो बहुभाषी वाक् पहचान के साथ-साथ वाक् अनुवाद और भाषा पहचान भी कर सकता है।

जीपीटी-4

14 मार्च, 2023 को, OpenAI ने जनरेटिव प्री-ट्रेन्ड ट्रांसफॉर्मर 4 (GPT-4) जारी करने की घोषणा की, जो टेक्स्ट या इमेज इनपुट स्वीकार करने में सक्षम है। OpenAI ने घोषणा की कि अद्यतन तकनीक ने एक सिम्युलेटेड लॉ स्कूल बार परीक्षा उत्तीर्ण की है, जिसमें शीर्ष 10% परीक्षार्थियों का स्कोर है; इसके विपरीत, पूर्व संस्करण, GPT-3.5, ने लगभग 10% नीचे स्कोर किया। GPT-4 पाठ के 25,000 शब्दों तक पढ़, विश्लेषण या उत्पन्न कर सकता है, और सभी प्रमुख प्रोग्रामिंग भाषाओं में कोड लिख सकता है।

उपयोगकर्ता इंटरफेस

म्यूज़नेट और ज्यूकबॉक्स (संगीत)

2019 में जारी, MuseNet मिडी संगीत फ़ाइलों में बाद के संगीत नोटों की भविष्यवाणी करने के लिए प्रशिक्षित एक गहरा तंत्रिका जाल है। यह पंद्रह अलग-अलग शैलियों में दस अलग-अलग वाद्ययंत्रों के साथ गाने उत्पन्न कर सकता है। द वर्ज के अनुसार, म्यूज़नेट द्वारा उत्पन्न एक गाना यथोचित रूप से शुरू होता है, लेकिन फिर जितनी देर तक बजता है, उतनी देर तक अराजकता में पड़ जाता है। पॉप संस्कृति में, इस उपकरण के शुरुआती अनुप्रयोगों का उपयोग 2020 की शुरुआत में इंटरनेट मनोवैज्ञानिक थ्रिलर बेन ड्रोन के लिए किया गया था ताकि टिट्युलर चरित्र के लिए संगीत तैयार किया जा सके।

2020 में रिलीज़ किया गया, ज्यूकबॉक्स वोकल्स के साथ संगीत उत्पन्न करने के लिए एक ओपन-सोर्स एल्गोरिथम है। 1.2 पर प्रशिक्षण के बाद मिलियन नमूने, सिस्टम एक शैली, कलाकार और गीतों के एक स्निपेट को स्वीकार करता है और गाने के नमूने आउटपुट करता है। OpenAI ने कहा कि गाने "स्थानीय संगीत सुसंगतता दिखाते हैं पारंपरिक राग पैटर्न का पालन करते हैं" लेकिन स्वीकार किया कि गीतों में "परिचित बड़े संगीत संरचनाओं जैसे कोरस जो दोहराते हैं" और ज्यूकबॉक्स और मानव-निर्मित संगीत के बीच "एक महत्वपूर्ण अंतर है" का अभाव है। . द वर्ज ने कहा "यह तकनीकी रूप से प्रभावशाली है, भले ही परिणाम गाने के भावपूर्ण संस्करण की तरह लगें जो परिचित महसूस कर सकते हैं", जबकि बिजनेस इनसाइडर ने कहा "आश्चर्यजनक रूप से, परिणामी गीतों में से कुछ आकर्षक और ध्वनि वैध हैं"।

माइक्रोस्कोप

2020 में जारी, माइक्रोस्कोप हर महत्वपूर्ण परत और आठ अलग-अलग तंत्रिका नेटवर्क मॉडल के न्यूरॉन के विज़ुअलाइज़ेशन का एक संग्रह है, जिसका अक्सर व्याख्यात्मक अध्ययन किया जाता है। इन तंत्रिका नेटवर्क के अंदर बनने वाली सुविधाओं का आसानी से विश्लेषण करने के लिए माइक्रोस्कोप बनाया गया था। शामिल मॉडल में एलेक्सनेट, वीजीजी 19, इंसेप्शन के विभिन्न संस्करण और सीएलआईपी रेसनेट के विभिन्न संस्करण शामिल हैं।

डीएएल-ई और क्लिप (छवियां)

2021 में सामने आया, DALL-E एक ट्रांसफ़ॉर्मर मॉडल है जो पाठ्य विवरण से चित्र बनाता है।

2021 में भी सामने आया, CLIP इसके विपरीत करता है: यह किसी दिए गए चित्र के लिए विवरण बनाता है। DALL-E GPT-3 के 12-बिलियन-पैरामीटर संस्करण का उपयोग प्राकृतिक भाषा इनपुट की व्याख्या करने के लिए करता है (जैसे "एक हरे रंग का चमड़े का पर्स जो पेंटागन के आकार का होता है" या "एक उदास कैपीबारा का एक आइसोमेट्रिक दृश्य") और संबंधित छवियां उत्पन्न करता है। यह यथार्थवादी वस्तुओं ("नीले स्ट्रॉबेरी की छवि के साथ एक सना हुआ ग्लास खिड़की") के साथ-साथ ऐसी वस्तुओं की छवियां बना सकता है जो वास्तविकता में मौजूद नहीं हैं ("एक साही की बनावट वाला घन")। मार्च 2021 तक, कोई एपीआई या कोड उपलब्ध नहीं है।

मार्च 2021 में, OpenAI ने कृत्रिम तंत्रिका नेटवर्क में मल्टीमॉडल न्यूरॉन्स नामक एक पेपर जारी किया, जहां उन्होंने CLIP (और GPT) मॉडल और उनकी कमजोरियों का विस्तृत विश्लेषण दिखाया। इस कार्य में ऐसे मॉडलों पर नए प्रकार के हमलों का वर्णन किया गया था।

Error: No text given for quotation (or equals sign used in the actual argument to an unnamed parameter)

दाल-ई 2

अप्रैल 2022 में, OpenAI ने DALL-E 2 की घोषणा की, जो अधिक यथार्थवादी परिणामों के साथ मॉडल का एक अद्यतन संस्करण है। दिसंबर 2022 में, OpenAI ने टेक्स्ट-विवरण को 3-आयामी मॉडल में बदलने के लिए एक नई अल्पविकसित प्रणाली, पॉइंट-ई के लिए GitHub सॉफ़्टवेयर पर प्रकाशित किया।

चैटजीपीटी

नवंबर 2022 में लॉन्च किया गया, चैटजीपीटी एक आर्टिफिशियल इंटेलिजेंस टूल है जो जीपीटी-3 के शीर्ष पर बनाया गया है जो एक संवादात्मक इंटरफ़ेस प्रदान करता है जो उपयोगकर्ताओं को प्राकृतिक भाषा में प्रश्न पूछने की अनुमति देता है। सिस्टम तब सेकंड के भीतर एक उत्तर के साथ प्रतिक्रिया करता है। चैटजीपीटी लॉन्च के 5 दिन बाद 10 लाख यूजर्स तक पहुंच गया।

चैटजीपीटी प्लस

चैटजीपीटी प्लस एक $20/माह की सब्सक्रिप्शन सेवा है जो उपयोगकर्ताओं को पीक आवर्स के दौरान चैटजीपीटी का उपयोग करने की अनुमति देती है, तेजी से प्रतिक्रिया समय प्रदान करती है, और उपयोगकर्ताओं को नई सुविधाओं तक जल्दी पहुंच प्रदान करती है।

- ↑ Langston, Jennifer (January 11, 2023). "Microsoft announces new supercomputer, lays out vision for future AI work". Source. मूल से February 10, 2023 को पुरालेखित. अभिगमन तिथि February 10, 2023.

Built in collaboration with and exclusively for OpenAI

Langston, Jennifer (January 11, 2023). - ↑ Foley, Mary Jo (May 19, 2020). "Microsoft builds a supercomputer for OpenAI for training massive AI models". ZDNET. मूल से February 10, 2023 को पुरालेखित. अभिगमन तिथि February 10, 2023.Foley, Mary Jo (May 19, 2020).

- ↑ "Microsoft's OpenAI supercomputer has 285,000 CPU cores, 10,000 GPUs". Engadget. May 19, 2020. मूल से February 10, 2023 को पुरालेखित. अभिगमन तिथि February 10, 2023.

Microsoft's OpenAI supercomputer has 285,000 CPU cores, 10,000 GPUs. It's one of the five fastest systems in the world.

"Microsoft's OpenAI supercomputer has 285,000 CPU cores, 10,000 GPUs". - ↑ Empty citation (मदद)"Sam Altman on His Plan to Keep A.I. Out of the Hands of the "Bad Guys"".

- ↑ "Introducing OpenAI". OpenAI. December 12, 2015. Archived from the original on August 8, 2017. Retrieved January 27, 2023.

- ↑ "OpenAI, the company behind ChatGPT: What all it does, how it started and more". The Times of India (अंग्रेज़ी में). January 25, 2023. मूल से February 3, 2023 को पुरालेखित. अभिगमन तिथि January 28, 2023."OpenAI, the company behind ChatGPT: What all it does, how it started and more".

- ↑ Browne, Ryan. "Microsoft reportedly plans to invest $10 billion in creator of buzzy A.I. tool ChatGPT". CNBC (अंग्रेज़ी में). मूल से February 3, 2023 को पुरालेखित. अभिगमन तिथि January 27, 2023.Browne, Ryan.

- ↑ Lardinois, Frederic (March 14, 2023). "Microsoft's new Bing was using GPT-4 all along". TechCrunch (अंग्रेज़ी में). अभिगमन तिथि March 30, 2023.Lardinois, Frederic (March 14, 2023).

- ↑ "Introducing OpenAI". OpenAI (अंग्रेज़ी में). December 12, 2015. मूल से August 8, 2017 को पुरालेखित. अभिगमन तिथि December 23, 2022."Introducing OpenAI".

- ↑ "Introducing OpenAI". OpenAI Blog. December 12, 2015. मूल से February 24, 2019 को पुरालेखित. अभिगमन तिथि September 29, 2018."Introducing OpenAI" Archived 2019-02-24 at the वेबैक मशीन.

- ↑ "Tech giants pledge $1bn for 'altruistic AI' venture, OpenAI". BBC News. December 12, 2015. मूल से March 14, 2018 को पुरालेखित. अभिगमन तिथि December 19, 2015."Tech giants pledge $1bn for 'altruistic AI' venture, OpenAI".

- ↑ Conger, Kate. "Elon Musk's Neuralink Sought to Open an Animal Testing Facility in San Francisco". Gizmodo (अंग्रेज़ी में). मूल से September 24, 2018 को पुरालेखित. अभिगमन तिथि October 11, 2018.Conger, Kate.

- ↑ Hao, Karen (February 17, 2020). "The messy, secretive reality behind OpenAI's bid to save the world". MIT Technology Review (अंग्रेज़ी में). मूल से April 3, 2020 को पुरालेखित. अभिगमन तिथि March 9, 2020.Hao, Karen (February 17, 2020).

- ↑ अ आ इ ई उ ऊ ए Empty citation (मदद)Cade Metz (April 27, 2016).

- ↑ अ आ Dave Gershgorn (April 27, 2016). "Elon Musk's Artificial Intelligence Group Opens A 'Gym' To Train A.I." Popular Science. मूल से April 30, 2016 को पुरालेखित. अभिगमन तिथि April 29, 2016.Dave Gershgorn (April 27, 2016).

- ↑ Empty citation (मदद)Metz, Cade.

- ↑ Mannes, John. "OpenAI's Universe is the fun parent every artificial intelligence deserves". TechCrunch. मूल से February 19, 2019 को पुरालेखित. अभिगमन तिथि December 31, 2016.Mannes, John.

- ↑ "OpenAI – Universe" (अंग्रेज़ी में). मूल से 1 जनवरी 2017 को पुरालेखित. अभिगमन तिथि December 31, 2016..

- ↑ Claburn, Thomas. "Elon Musk-backed OpenAI reveals Universe – a universal training ground for computers". The Register. मूल से January 1, 2017 को पुरालेखित. अभिगमन तिथि December 31, 2016.Claburn, Thomas.

- ↑ "Microsoft to invest $1 billion in OpenAI". Reuters (अंग्रेज़ी में). July 22, 2019. मूल से May 25, 2020 को पुरालेखित. अभिगमन तिथि March 6, 2020."Microsoft to invest $1 billion in OpenAI".

- ↑ Vincent, James (February 21, 2018). "Elon Musk leaves board of AI safety group to avoid conflict of interest with Tesla". The Verge. मूल से November 9, 2020 को पुरालेखित. अभिगमन तिथि February 22, 2018.Vincent, James (February 21, 2018).

- ↑ "The secret history of Elon Musk, Sam Altman, and OpenAI | Semafor". www.semafor.com (अंग्रेज़ी में). March 24, 2023. अभिगमन तिथि March 30, 2023."The secret history of Elon Musk, Sam Altman, and OpenAI | Semafor". www.semafor.com.

- ↑ "OpenAI shifts from nonprofit to 'capped-profit' to attract capital" (अंग्रेज़ी में). March 11, 2019. मूल से January 4, 2023 को पुरालेखित. अभिगमन तिथि January 4, 2023."OpenAI shifts from nonprofit to 'capped-profit' to attract capital".

- ↑ अ आ Empty citation (मदद)"To Compete With Google, OpenAI Seeks Investors–and Profits".

- ↑ अ आ Kahn, Jeremy (March 11, 2019). "AI Research Group Co-Founded by Elon Musk Starts For-Profit Arm". Bloomberg News. मूल से December 7, 2019 को पुरालेखित. अभिगमन तिथि March 6, 2020.Kahn, Jeremy (March 11, 2019).

- ↑ Metz, Cade (April 19, 2018). "A.I. Researchers Are Making More Than $1 Million, Even at a Nonprofit". The New York Times (अंग्रेज़ी में). आइ॰एस॰एस॰एन॰ 0362-4331. मूल से August 8, 2018 को पुरालेखित. अभिगमन तिथि January 28, 2023.Metz, Cade (April 19, 2018).

- ↑ "Microsoft invests in and partners with OpenAI" (अंग्रेज़ी में). July 22, 2019."Microsoft invests in and partners with OpenAI".

- ↑ "Microsoft Invests in and Partners with OpenAI to Support Us Building Beneficial AGI". OpenAI (अंग्रेज़ी में). July 22, 2019. मूल से November 7, 2020 को पुरालेखित. अभिगमन तिथि February 21, 2020."Microsoft Invests in and Partners with OpenAI to Support Us Building Beneficial AGI".

- ↑ Murgia, Madhumita (August 7, 2019). "DeepMind runs up higher losses and debts in race for AI". Financial Times. मूल से December 26, 2019 को पुरालेखित. अभिगमन तिथि March 6, 2020.Murgia, Madhumita (August 7, 2019).

- ↑ "OpenAI Will Need More Capital Than Any Non-Profit Has Ever Raised". Fortune (अंग्रेज़ी में). मूल से December 8, 2019 को पुरालेखित. अभिगमन तिथि March 6, 2020."OpenAI Will Need More Capital Than Any Non-Profit Has Ever Raised".

- ↑ Vincent, James (July 22, 2019). "Microsoft invests $1 billion in OpenAI to pursue holy grail of artificial intelligence". The Verge (अंग्रेज़ी में). मूल से July 23, 2019 को पुरालेखित. अभिगमन तिथि March 6, 2020.Vincent, James (July 22, 2019).

- ↑ Vance, Ashlee (June 11, 2020). "Trillions of Words Analyzed, OpenAI Sets Loose AI Language Colossus". Bloomberg News. मूल से October 13, 2020 को पुरालेखित. अभिगमन तिथि June 12, 2020.Vance, Ashlee (June 11, 2020).

- ↑ "OpenAI debuts DALL-E for generating images from text". VentureBeat. January 5, 2021. मूल से पुरालेखित 5 जनवरी 2021. अभिगमन तिथि January 5, 2021.सीएस1 रखरखाव: BOT: original-url status unknown (link).

- ↑ Roose, Kevin (December 5, 2022). "The Brilliance and Weirdness of ChatGPT". The New York Times. मूल से January 18, 2023 को पुरालेखित. अभिगमन तिथि January 5, 2023.Roose, Kevin (December 5, 2022).

- ↑ Dastin, Jeffrey; Hu, Krystal; Dave, Paresh; Dave, Paresh (December 15, 2022). "Exclusive: ChatGPT owner OpenAI projects $1 billion in revenue by 2024". Reuters (अंग्रेज़ी में). मूल से February 3, 2023 को पुरालेखित. अभिगमन तिथि January 5, 2023.Dastin, Jeffrey; Hu, Krystal; Dave, Paresh; Dave, Paresh (December 15, 2022).

- ↑ Kruppa, Berber Jin and Miles. "WSJ News Exclusive | ChatGPT Creator in Investor Talks at $29 Billion Valuation". WSJ (अंग्रेज़ी में). मूल से February 3, 2023 को पुरालेखित. अभिगमन तिथि January 6, 2023.Kruppa, Berber Jin and Miles.

- ↑ "Microsoft Adds $10 Billion to Investment in ChatGPT Maker OpenAI". Bloomberg.com (अंग्रेज़ी में). January 23, 2023. मूल से January 23, 2023 को पुरालेखित. अभिगमन तिथि January 23, 2023."Microsoft Adds $10 Billion to Investment in ChatGPT Maker OpenAI".

- ↑ Capoot, Ashley. "Microsoft announces multibillion-dollar investment in ChatGPT-maker OpenAI". CNBC (अंग्रेज़ी में). मूल से January 23, 2023 को पुरालेखित. अभिगमन तिथि January 23, 2023.Capoot, Ashley.

- ↑ "Bard: Google launches ChatGPT rival". BBC News (अंग्रेज़ी में). February 6, 2023. मूल से February 7, 2023 को पुरालेखित. अभिगमन तिथि February 7, 2023."Bard: Google launches ChatGPT rival".

- ↑ Vincent, James (February 8, 2023). "Google's AI chatbot Bard makes factual error in first demo". The Verge (अंग्रेज़ी में). मूल से February 12, 2023 को पुरालेखित. अभिगमन तिथि February 12, 2023.Vincent, James (February 8, 2023).

- ↑ Dotan, Tom. "Microsoft Adds ChatGPT AI Technology to Bing Search Engine". WSJ (अंग्रेज़ी में). मूल से February 7, 2023 को पुरालेखित. अभिगमन तिथि February 7, 2023.Dotan, Tom.

- ↑ Dastin, Jeffrey (March 3, 2023). "OpenAI's long-time backer Reid Hoffman leaves board". Reuters (अंग्रेज़ी में). अभिगमन तिथि March 17, 2023.Dastin, Jeffrey (March 3, 2023).

- ↑ "GPT-4". openai.com (अंग्रेज़ी में). अभिगमन तिथि March 16, 2023."GPT-4". openai.com.

- ↑ "PwC US to invest $1 billion for expanding generative AI capabilities in collaboration with Microsoft". VentureBeat (अंग्रेज़ी में). 2023-04-26. अभिगमन तिथि 2023-04-26."PwC US to invest $1 billion for expanding generative AI capabilities in collaboration with Microsoft".

- ↑ Bass, Dina (July 22, 2019). "Microsoft to invest $1 billion in OpenAI". Los Angeles Times. मूल से July 22, 2019 को पुरालेखित. अभिगमन तिथि July 22, 2019.Bass, Dina (July 22, 2019).

- ↑ अ आ इ Bordoloi, Pritam (May 9, 2022). "OpenAI gets a new president, CTO & COO in the latest rejig". AIM. मूल से October 16, 2022 को पुरालेखित. अभिगमन तिथि October 11, 2022.Bordoloi, Pritam (May 9, 2022).

- ↑ अ आ इ ई "Silicon Valley investors to bankroll artificial-intelligence center". The Seattle Times. December 13, 2015. मूल से January 5, 2016 को पुरालेखित. अभिगमन तिथि December 19, 2015."Silicon Valley investors to bankroll artificial-intelligence center".

- ↑ अ आ Liedtke, Michael. "Elon Musk, Peter Thiel, Reid Hoffman, others back $1 billion OpenAI research center". Mercury News. मूल से December 22, 2015 को पुरालेखित. अभिगमन तिथि December 19, 2015.Liedtke, Michael.

- ↑ Vincent, James (July 22, 2019). "Microsoft invests $1 billion in OpenAI to pursue holy grail of artificial intelligence". The Verge. मूल से July 23, 2019 को पुरालेखित. अभिगमन तिथि July 23, 2019.Vincent, James (July 22, 2019).

- ↑ "About OpenAI". OpenAI (अंग्रेज़ी में). December 11, 2015. मूल से December 22, 2017 को पुरालेखित. अभिगमन तिथि December 23, 2022."About OpenAI".

- ↑ "Elon Musk, Infosys, others back OpenAI with $1 bn". Business Standard India. Indo-Asian News Service. December 12, 2015. मूल से August 30, 2019 को पुरालेखित. अभिगमन तिथि August 30, 2019."Elon Musk, Infosys, others back OpenAI with $1 bn".

- ↑ Empty citation (मदद)Cade Metz (April 27, 2016).

- ↑ Empty citation (मदद)"Sam Altman's Manifest Destiny".

- ↑ Vincent, James (February 21, 2019). "AI researchers debate the ethics of sharing potentially harmful programs". The Verge (अंग्रेज़ी में). मूल से February 9, 2021 को पुरालेखित. अभिगमन तिथि March 6, 2020.Vincent, James (February 21, 2019).

- ↑ "Our approach to alignment research". openai.com (अंग्रेज़ी में). अभिगमन तिथि 2023-04-26."Our approach to alignment research". openai.com.

- ↑ Greg Brockman; John Schulman (April 27, 2016). "OpenAI Gym Beta". OpenAI Blog (अंग्रेज़ी में). OpenAI. मूल से February 26, 2019 को पुरालेखित. अभिगमन तिथि April 29, 2016.Greg Brockman; John Schulman (April 27, 2016).

- ↑ "OpenAI Gym". GitHub. मूल से 28 जनवरी 2019 को पुरालेखित. अभिगमन तिथि May 8, 2017..

- ↑ Brockman, Greg (September 12, 2017). "Yep, the Github repo has been the focus of the project for the past year. The Gym site looks cool but hasn't been maintained". @gdb (अंग्रेज़ी में). मूल से September 13, 2017 को पुरालेखित. अभिगमन तिथि November 7, 2017.Brockman, Greg (September 12, 2017).

- ↑ अ आ इ Empty citation (मदद)"AI Sumo Wrestlers Could Make Future Robots More Nimble".

- ↑ "OpenAI's Goofy Sumo-Wrestling Bots Are Smarter Than They Look". MIT Technology Review (अंग्रेज़ी में). मूल से November 9, 2018 को पुरालेखित. अभिगमन तिथि November 2, 2017."OpenAI's Goofy Sumo-Wrestling Bots Are Smarter Than They Look".

- ↑ Savov, Vlad (August 14, 2017). "My favorite game has been invaded by killer AI bots and Elon Musk hype". The Verge. मूल से June 26, 2018 को पुरालेखित. अभिगमन तिथि June 25, 2018.Savov, Vlad (August 14, 2017).

- ↑ Frank, Blair Hanley. "OpenAI's bot beats top Dota 2 player so badly that he quits". Venture Beat. मूल से August 12, 2017 को पुरालेखित. अभिगमन तिथि August 12, 2017.Frank, Blair Hanley.

- ↑ "Dota 2". blog.openai.com. August 11, 2017. मूल से August 11, 2017 को पुरालेखित. अभिगमन तिथि August 12, 2017."Dota 2" Archived 2017-08-11 at the वेबैक मशीन. blog.openai.com.

- ↑ "More on Dota 2". blog.openai.com. August 16, 2017. मूल से February 23, 2019 को पुरालेखित. अभिगमन तिथि August 16, 2017."More on Dota 2" Archived 2019-02-23 at the वेबैक मशीन. blog.openai.com.

- ↑ अ आ Empty citation (मदद)Simonite, Tom.

- ↑ Kahn, Jeremy (June 25, 2018). "A Bot Backed by Elon Musk Has Made an AI Breakthrough in Video Game World". Bloomberg.com. Bloomberg L.P. मूल से June 27, 2018 को पुरालेखित. अभिगमन तिथि June 27, 2018.Kahn, Jeremy (June 25, 2018).

- ↑ Clifford, Catherine (June 28, 2018). "Bill Gates says gamer bots from Elon Musk-backed nonprofit are 'huge milestone' in A.I." CNBC. मूल से June 28, 2018 को पुरालेखित. अभिगमन तिथि June 29, 2018.Clifford, Catherine (June 28, 2018).

- ↑ "OpenAI Five Benchmark". blog.openai.com. July 18, 2018. मूल से February 13, 2019 को पुरालेखित. अभिगमन तिथि August 25, 2018."OpenAI Five Benchmark" Archived 2019-02-13 at the वेबैक मशीन. blog.openai.com.

- ↑ Vincent, James (June 25, 2018). "AI bots trained for 180 years a day to beat humans at Dota 2". The Verge. मूल से June 25, 2018 को पुरालेखित. अभिगमन तिथि June 25, 2018.Vincent, James (June 25, 2018).

- ↑ Savov, Vlad (August 6, 2018). "The OpenAI Dota 2 bots just defeated a team of former pros". The Verge. मूल से August 7, 2018 को पुरालेखित. अभिगमन तिथि August 7, 2018.Savov, Vlad (August 6, 2018).

- ↑ Empty citation (मदद)Simonite, Tom.

- ↑ Quach, Katyanna. "Game over, machines: Humans defeat OpenAI bots once again at video games Olympics". The Register. मूल से August 25, 2018 को पुरालेखित. अभिगमन तिथि August 25, 2018.Quach, Katyanna.

- ↑ "The International 2018: Results". blog.openai.com. August 24, 2018. मूल से August 24, 2018 को पुरालेखित. अभिगमन तिथि August 25, 2018."The International 2018: Results" Archived 2018-08-24 at the वेबैक मशीन. blog.openai.com.

- ↑ Statt, Nick (April 13, 2019). "OpenAI's Dota 2 AI steamrolls world champion e-sports team with back-to-back victories". The Verge. मूल से April 15, 2019 को पुरालेखित. अभिगमन तिथि July 20, 2019.Statt, Nick (April 13, 2019).

- ↑ "How to Train Your OpenAI Five". OpenAI Blog. April 15, 2019. मूल से June 30, 2019 को पुरालेखित. अभिगमन तिथि July 20, 2019."How to Train Your OpenAI Five".

- ↑ Wiggers, Kyle (April 22, 2019). "OpenAI's Dota 2 bot defeated 99.4% of players in public matches". Venture Beat. मूल से July 11, 2019 को पुरालेखित. अभिगमन तिथि April 22, 2019.Wiggers, Kyle (April 22, 2019).

- ↑ "Gym Retro". OpenAI (अंग्रेज़ी में). May 25, 2018. मूल से February 12, 2023 को पुरालेखित. अभिगमन तिथि February 12, 2023."Gym Retro".

- ↑ Greene, Tristan (May 4, 2018). "OpenAI's Debate Game teaches you and your friends how to lie like robots". The Next Web (अंग्रेज़ी में). मूल से May 5, 2018 को पुरालेखित. अभिगमन तिथि May 31, 2018.Greene, Tristan (May 4, 2018).

- ↑ "Why Scientists Think AI Systems Should Debate Each Other". Fast Company. May 8, 2018. मूल से May 19, 2018 को पुरालेखित. अभिगमन तिथि June 2, 2018."Why Scientists Think AI Systems Should Debate Each Other".

- ↑ Vincent, James (July 30, 2018). "OpenAI sets new benchmark for robot dexterity". The Verge (अंग्रेज़ी में). मूल से February 12, 2023 को पुरालेखित. अभिगमन तिथि February 12, 2023.Vincent, James (July 30, 2018).

- ↑ OpenAI; Andrychowicz, Marcin. "Learning Dexterous In-Hand Manipulation". arXiv:1808.00177v5 .OpenAI; Andrychowicz, Marcin; Baker, Bowen; Chociej, Maciek; Józefowicz, Rafał; McGrew, Bob; Pachocki, Jakub; Petron, Arthur; Plappert, Matthias; Powell, Glenn; Ray, Alex; Schneider, Jonas; Sidor, Szymon; Tobin, Josh; Welinder, Peter; Weng, Lilian; Zaremba, Wojciech (2019).

- ↑ OpenAI; Akkaya, Ilge. "Solving Rubik's Cube with a Robot Hand". arXiv:1910.07113v1 .OpenAI; Akkaya, Ilge; Andrychowicz, Marcin; Chociej, Maciek; Litwin, Mateusz; McGrew, Bob; Petron, Arthur; Paino, Alex; Plappert, Matthias; Powell, Glenn; Ribas, Raphael (2019).

- ↑ अ आ "OpenAI API". OpenAI (अंग्रेज़ी में). June 11, 2020. मूल से June 11, 2020 को पुरालेखित. अभिगमन तिथि June 14, 2020.

Why did OpenAI choose to release an API instead of open-sourcing the models?

"OpenAI API".

There are three main reasons we did this. First, commercializing the technology helps us pay for our ongoing AI research, safety, and policy efforts. Second, many of the models underlying the API are very large, taking a lot of expertise to develop and deploy and making them very expensive to run. This makes it hard for anyone except larger companies to benefit from the underlying technology. We’re hopeful that the API will make powerful AI systems more accessible to smaller businesses and organizations. Third, the API model allows us to more easily respond to misuse of the technology. Since it is hard to predict the downstream use cases of our models, it feels inherently safer to release them via an API and broaden access over time, rather than release an open source model where access cannot be adjusted if it turns out to have harmful applications. - ↑ "TechCrunch Startup and Technology News". TechCrunch. June 11, 2020. मूल से June 12, 2020 को पुरालेखित. अभिगमन तिथि June 11, 2020.

If you’ve ever wanted to try out OpenAI's vaunted machine learning toolset, it just got a lot easier. The company has released an API that lets developers call its AI tools in on "virtually any English language task."

"TechCrunch Startup and Technology News". - ↑ "Improving Language Understanding by Generative Pre-Training" (PDF). मूल (PDF) से January 26, 2021 को पुरालेखित. अभिगमन तिथि June 9, 2020."Improving Language Understanding by Generative Pre-Training" (PDF).

- ↑ अ आ Hern, Alex (February 14, 2019). "New AI fake text generator may be too dangerous to release, say creators". The Guardian. मूल से February 14, 2019 को पुरालेखित. अभिगमन तिथि February 14, 2019.Hern, Alex (February 14, 2019).

- ↑ Schwartz, Oscar (July 4, 2019). "Could 'fake text' be the next global political threat?". The Guardian. मूल से July 16, 2019 को पुरालेखित. अभिगमन तिथि July 16, 2019.Schwartz, Oscar (July 4, 2019).

- ↑ Vincent, James (February 14, 2019). "OpenAI's new multitalented AI writes, translates, and slanders". The Verge. मूल से December 18, 2020 को पुरालेखित. अभिगमन तिथि July 16, 2019.Vincent, James (February 14, 2019).

- ↑ "GPT-2: 1.5B Release". OpenAI (अंग्रेज़ी में). November 5, 2019. मूल से November 14, 2019 को पुरालेखित. अभिगमन तिथि November 14, 2019."GPT-2: 1.5B Release".

- ↑ "Write With Transformer". मूल से December 4, 2019 को पुरालेखित. अभिगमन तिथि December 4, 2019."Write With Transformer" Archived 2019-12-04 at the वेबैक मशीन.

- ↑ "Talk to Transformer". मूल से December 4, 2019 को पुरालेखित. अभिगमन तिथि December 4, 2019."Talk to Transformer".

- ↑ "CreativeEngines". मूल से February 3, 2023 को पुरालेखित. अभिगमन तिथि June 25, 2021."CreativeEngines" Archived 2023-02-03 at the वेबैक मशीन.

- ↑ "Language Models are Unsupervised Multitask Learners" (PDF). मूल (PDF) से December 12, 2019 को पुरालेखित. अभिगमन तिथि December 4, 2019. Cite journal requires

|journal=(मदद)"Language Models are Unsupervised Multitask Learners" (PDF). - ↑ Ganesh, Prakhar (December 17, 2019). "Pre-trained Language Models: Simplified". मूल से February 3, 2023 को पुरालेखित. अभिगमन तिथि September 9, 2020.

The intuition behind pre-trained language models is to create a black box which understands the language and can then be asked to do any specific task in that language.

- ↑ "openai/gpt-3". OpenAI. May 29, 2020. मूल से November 14, 2020 को पुरालेखित. अभिगमन तिथि May 29, 2020."openai/gpt-3".

- ↑ Sagar, Ram (June 3, 2020). "OpenAI Releases GPT-3, The Largest Model So Far". Analytics India Magazine (अंग्रेज़ी में). मूल से August 4, 2020 को पुरालेखित. अभिगमन तिथि June 14, 2020.Sagar, Ram (June 3, 2020).

- ↑ अ आ इ ई Brown, Tom; Mann, Benjamin (June 1, 2020). "Language Models are Few-Shot Learners". arXiv:2005.14165 .Brown, Tom; Mann, Benjamin; Ryder, Nick; Subbiah, Melanie; Kaplan, Jared; Dhariwal, Prafulla; Neelakantan, Arvind; Shyam, Pranav; Sastry, Girish; Askell, Amanda; Agarwal, Sandhini (June 1, 2020).

- ↑ "Language Models are Unsupervised Multitask Learners" (PDF). मूल (PDF) से December 12, 2019 को पुरालेखित. अभिगमन तिथि December 4, 2019.

GPT-2, is a 1.5B parameter Transformer

Cite journal requires|journal=(मदद)"Language Models are Unsupervised Multitask Learners" (PDF). - ↑ Brown, Tom; Mann, Benjamin (June 1, 2020). "Language Models are Few-Shot Learners". arXiv:2005.14165 .Brown, Tom; Mann, Benjamin; Ryder, Nick; Subbiah, Melanie; Kaplan, Jared; Dhariwal, Prafulla; Neelakantan, Arvind; Shyam, Pranav; Sastry, Girish; Askell, Amanda; Agarwal, Sandhini (June 1, 2020).

- ↑ Ray, Tiernan (2020). "OpenAI's gigantic GPT-3 hints at the limits of language models for AI" (अंग्रेज़ी में). ZDNet. मूल से June 1, 2020 को पुरालेखित. अभिगमन तिथि June 5, 2020.Ray, Tiernan (2020).

- ↑ Amodei, Dario; Hernandez, Danny (May 16, 2018). "AI and Compute". मूल से June 17, 2020 को पुरालेखित. अभिगमन तिथि August 30, 2020.

A petaflop/s-day (pfs-day) consists of performing 1015 neural net operations per second for one day, or a total of about 1020 operations. The compute-time product serves as a mental convenience, similar to kW-hr for energy.

- ↑ Eadicicco, Lisa. "The artificial intelligence company that Elon Musk helped found is now selling the text-generation software it previously said was too dangerous to launch". Business Insider. मूल से November 14, 2020 को पुरालेखित. अभिगमन तिथि July 6, 2020.Eadicicco, Lisa.

- ↑ "OpenAI is giving Microsoft exclusive access to its GPT-3 language model". MIT Technology Review (अंग्रेज़ी में). मूल से February 5, 2021 को पुरालेखित. अभिगमन तिथि September 24, 2020."OpenAI is giving Microsoft exclusive access to its GPT-3 language model".

- ↑ "Microsoft gets exclusive license for OpenAI's GPT-3 language model". VentureBeat (अंग्रेज़ी में). September 22, 2020. मूल से November 8, 2020 को पुरालेखित. अभिगमन तिथि September 24, 2020."Microsoft gets exclusive license for OpenAI's GPT-3 language model".

- ↑ अ आ Alford, Anthony (August 31, 2021). "OpenAI Announces 12 Billion Parameter Code-Generation AI Codex". InfoQ. मूल से July 9, 2022 को पुरालेखित. अभिगमन तिथि September 3, 2021.Alford, Anthony (August 31, 2021).

- ↑ अ आ Wiggers, Kyle (July 8, 2021). "OpenAI warns AI behind GitHub's Copilot may be susceptible to bias". VentureBeat. मूल से February 3, 2023 को पुरालेखित. अभिगमन तिथि September 3, 2021.Wiggers, Kyle (July 8, 2021).

- ↑ Zaremba, Wojciech (August 10, 2021). "OpenAI Codex". OpenAI. मूल से February 3, 2023 को पुरालेखित. अभिगमन तिथि September 3, 2021.Zaremba, Wojciech (August 10, 2021).

- ↑ Dickson, Ben (August 16, 2021). "What to expect from OpenAI's Codex API". VentureBeat. मूल से February 3, 2023 को पुरालेखित. अभिगमन तिथि September 3, 2021.Dickson, Ben (August 16, 2021).

- ↑ Claburn, Thomas (August 25, 2021). "GitHub's Copilot may steer you into dangerous waters about 40% of the time – study". The Register. मूल से February 3, 2023 को पुरालेखित. अभिगमन तिथि September 3, 2021.Claburn, Thomas (August 25, 2021).

- ↑ "GitHub Copilot: The Latest in the List of AI Generative Models Facing Copyright Allegations". Analytics India Magazine. October 23, 2022. अभिगमन तिथि March 23, 2023."GitHub Copilot: The Latest in the List of AI Generative Models Facing Copyright Allegations".

- ↑ "OpenAI Might Invite Legal Trouble". Analytics India Magazine. March 21, 2023. अभिगमन तिथि March 23, 2023."OpenAI Might Invite Legal Trouble".

- ↑ "OpenAI to discontinue support for the Codex API". Hacker News. अभिगमन तिथि March 23, 2023."OpenAI to discontinue support for the Codex API".

- ↑ Wiggers, Kyle (September 21, 2022). "OpenAI open-sources Whisper, a multilingual speech recognition system". TechCrunch (अंग्रेज़ी में). मूल से February 12, 2023 को पुरालेखित. अभिगमन तिथि February 12, 2023.Wiggers, Kyle (September 21, 2022).

- ↑ Radford, Alec; Kim, Jong Wook. "Robust Speech Recognition via Large-Scale Weak Supervision". arXiv:2212.04356 .Radford, Alec; Kim, Jong Wook; Xu, Tao; Brockman, Greg; McLeavey, Christine; Sutskever, Ilya (2022).

- ↑ Vincent, James (March 14, 2023). "OpenAI announces GPT-4 — the next generation of its AI language model". The Verge (अंग्रेज़ी में). मूल से March 14, 2023 को पुरालेखित. अभिगमन तिथि March 14, 2023.Vincent, James (March 14, 2023).

- ↑ Wiggers, Kyle (March 14, 2023). "OpenAI releases GPT-4, a multimodal AI that it claims is state-of-the-art". TechCrunch (अंग्रेज़ी में). मूल से March 15, 2023 को पुरालेखित. अभिगमन तिथि March 14, 2023.Wiggers, Kyle (March 14, 2023).

- ↑ "OpenAI's MuseNet generates AI music at the push of a button". The Verge. April 2019. मूल से June 28, 2019 को पुरालेखित. अभिगमन तिथि June 8, 2020."OpenAI's MuseNet generates AI music at the push of a button".

- ↑ "MuseNet". OpenAI. April 25, 2019. मूल से June 13, 2020 को पुरालेखित. अभिगमन तिथि June 8, 2020."MuseNet".

- ↑ "Arcade Attack Podcast – September (4 of 4) 2020 - Alex Hall (Ben Drowned) - Interview". Arcade Attack. September 28, 2020. मूल से February 3, 2023 को पुरालेखित. अभिगमन तिथि January 29, 2023."Arcade Attack Podcast – September (4 of 4) 2020 - Alex Hall (Ben Drowned) - Interview".

- ↑ "Archived copy". मूल से February 3, 2023 को पुरालेखित. अभिगमन तिथि January 29, 2023.सीएस1 रखरखाव: Archived copy as title (link)"Archived copy".

- ↑ "OpenAI introduces Jukebox, a new AI model that generates genre-specific music". The Verge. April 30, 2020. मूल से June 8, 2020 को पुरालेखित. अभिगमन तिथि June 8, 2020."OpenAI introduces Jukebox, a new AI model that generates genre-specific music".

- ↑ Stephen, Bijan (April 30, 2020). "OpenAI introduces Jukebox, a new AI model that generates genre-specific music". Business Insider (अंग्रेज़ी में). मूल से June 8, 2020 को पुरालेखित. अभिगमन तिथि June 8, 2020.Stephen, Bijan (April 30, 2020).

- ↑ "Jukebox". OpenAI. April 30, 2020. मूल से June 8, 2020 को पुरालेखित. अभिगमन तिथि June 8, 2020."Jukebox".

- ↑ "OpenAI Microscope". April 14, 2020. मूल से February 3, 2023 को पुरालेखित. अभिगमन तिथि March 27, 2021."OpenAI Microscope".

- ↑ Johnson, Khari (April 14, 2020). "OpenAI launches Microscope to visualize the neurons in popular machine learning models". VentureBeat (अंग्रेज़ी में). मूल से February 12, 2023 को पुरालेखित. अभिगमन तिथि February 12, 2023.Johnson, Khari (April 14, 2020).

- ↑ "OpenAI Microscope". OpenAI Microscope. मूल से February 3, 2023 को पुरालेखित. अभिगमन तिथि March 27, 2021."OpenAI Microscope".

- ↑ "DALL·E: Creating Images from Text". January 5, 2021. मूल से March 27, 2021 को पुरालेखित. अभिगमन तिथि March 27, 2021."DALL·E: Creating Images from Text".

- ↑ "CLIP: Connecting Text and Images". January 5, 2021. मूल से March 25, 2021 को पुरालेखित. अभिगमन तिथि March 27, 2021."CLIP: Connecting Text and Images".

- ↑ "Multimodal Neurons in Artificial Neural Networks". March 4, 2021. मूल से February 3, 2023 को पुरालेखित. अभिगमन तिथि March 27, 2021."Multimodal Neurons in Artificial Neural Networks".

- ↑ "DALL·E 2". OpenAI (अंग्रेज़ी में). मूल से April 6, 2022 को पुरालेखित. अभिगमन तिथि April 6, 2022."DALL·E 2".

- ↑ "ChatGPT: A scientist explains the hidden genius and pitfalls of OpenAI's chatbot". BBC Science Focus Magazine (अंग्रेज़ी में). 2022. मूल से February 3, 2023 को पुरालेखित. अभिगमन तिथि December 30, 2022."ChatGPT: A scientist explains the hidden genius and pitfalls of OpenAI's chatbot".

- ↑ "Mira Murati via Twitter". Mira Murati. December 5, 2022. मूल से December 14, 2022 को पुरालेखित. अभिगमन तिथि December 15, 2022."Mira Murati via Twitter".

- ↑ Wiggers, Kyle (February 1, 2023). "OpenAI launches ChatGPT Plus, starting at $20 per month". TechCrunch (अंग्रेज़ी में). मूल से February 12, 2023 को पुरालेखित. अभिगमन तिथि February 12, 2023.Wiggers, Kyle (February 1, 2023).

सन्दर्भ त्रुटि: "lower-alpha" नामक सन्दर्भ-समूह के लिए <ref> टैग मौजूद हैं, परन्तु समूह के लिए कोई <references group="lower-alpha"/> टैग नहीं मिला। यह भी संभव है कि कोई समाप्ति </ref> टैग गायब है।